Automatisiertes Fahren ist die Zukunft! FusionSystems entwickelt Erkennungssysteme und Komponenten für Fahrerassistenzsysteme und das Automatisierte Fahren. Unsere Schwerpunkte liegen auf den Themen Fahrzeugumfelderkennung, Navigation, Fahrzeugsteuerung, Fahrzeuginnenraumüberwachung sowie der Fahrzeugkommunikation. Entscheidende Bedeutung kommt dem Einsatz von Fahrzeugsensoren und der zugehörigen Multisensor-Datenfusion zu.

Im ENTWICKLUNGSPROZESS setzen wir Richtlinien von QA-C und MISRA um. Unsere Softwareentwicklung orientiert sich an dem bewährten V-Modell, mit dem alle Entwicklungsschritte durch unser Anforderungsmanagement begleitet, geprüft und entsprechend IEEE 29148-2011 dokumentiert werden. Bei der Entwicklung sicherheitsrelevanter Software orientieren wir uns an der ISO 26262. Unser Software-Engineering im Automotive Bereich folgt der an die internationale Standard ISO 15504 angelehnte Variante Automotive SPICE (Aspice). Für dessen Umsetzung nutzen wir Tools wie DOORS, Matlab/Simulink, dSpace, ADTF, C/C++/Python und CANoe sowie gängige Simulationstools wie CarMaker.

Robuste Wahrnehmung für sichere Mobilität

Zuverlässige Wahrnehmung ist die Basis jeder autonomen Entscheidung.

Automatisiertes Fahren erfordert stabile Objekterkennung unter Realbedingungen. Wetter, Licht und Dynamik dürfen kein Risiko darstellen. KI-basierte Segmentierung liefert Informationen über Fahrzeuge, Personen und Fahrbahnen. Aktuelle Modelle erlauben eine hohe Generalisierung in komplexen Szenen. Das reduziert Entwicklungsaufwand und erhöht Systemsicherheit.

FusionSystems bringt KI-Perception in reale Anwendungen. Sprechen Sie mit uns über robuste KI-Wahrnehmung in Mobilitätssystemen.

Sensorkompetenz

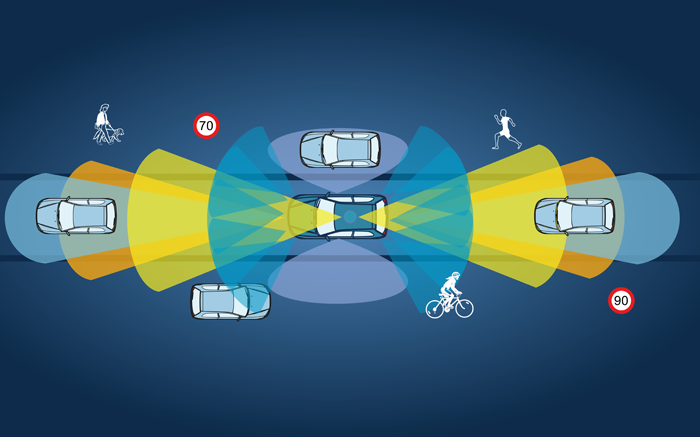

Die multisensorielle 360°-Umgebungserfassung liefert über die Abdeckung von Nah- und Fernbereich hinausgehende Aussagen, z.B. die sehr enge zeitliche Auflösung. Wir haben unser Sensorfahrzeug mit zusätzlichen Sensoren unterschiedlicher Art ausgestattet, um das Fahrzeugumfeld komplett zu erfassen. So sind unter anderem Zusatzkameras, wie ein Mehrkamerasystem im Frontgrill integriert, welches die 3D-Erfassung nach speziellen Stereo-Kamera-Ansätzen erlaubt. Dies ermöglicht die Erkennung von verschiedenen Funktionen, wie der Fahrbahn, der Fahrbahnmarkierung, von Verkehrszeichen, Hindernissen sowie von Fußgängern. Auf dem Dach unseres Sensorfahrzeugs können ein 360°-Laserscanner und eine Kugelkamera befestigt werden. Die gesammelten Messdaten können in Echtzeit von im Fahrzeug befindlichen Rechner- und Technikracks ausgewertet werden.

Als Multi-Sensor-Plattform zur 360° Umgebungserfassung für individuelle und hochgenaue Anforderungen wurde unser Sensorfahrzeug auf den Namen IRIS - Individual Data Recognition System getauft. Weitere Informationen erhalten Sie unter: www.irisystem.de.

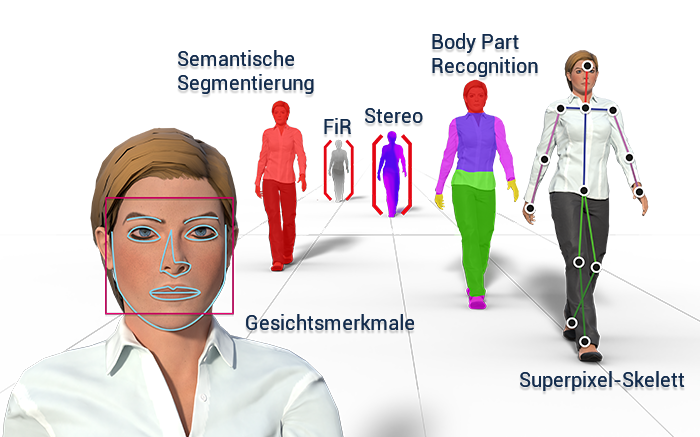

Personenerkennung

Eine wichtige Rolle bei der Fahrzeugumfelderkennung spielt die PERSONENERKENNUNG. Die Erkennung von Personen in Videobildern (FIR-Kamera, Grauwert-Kamera) und insbesondere die Erkennung und genaue Lokalisierung von Personen mit multisensoriellen Systemen (z.B. Infrarot-Kamera und Laserscanner) sind eine Kernkompetenz von FusionSystems. Unsere Erkennungssoftware zeichnet sich durch eine hohe Erkennungsleistung bei gleichzeitig niedrigen Falschalarmraten aus. Die konsequente Verwendung von Tracking-Methoden sorgt für die notwendige Stabilität der Erkennung. Weitere Informationen zu unseren Verfahren zur Personenerkennung finden Sie hier.

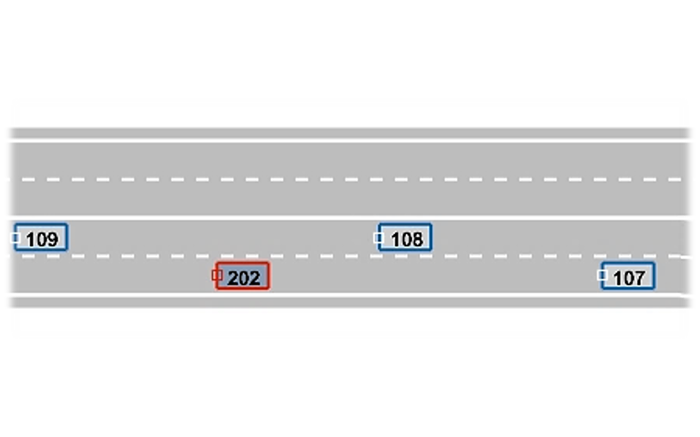

Neben Personen und Fussgängern können unsere Kamerasysteme aber auch die Fahrbahn erkennen, weshalb es wichtig ist, Kenntnisse über ihre Gestaltung, die Breite der Fahrstreifen und über ihre Beschaffenheit bzgl. Material, Oberfläche oder dem Vorhandensein von Markierungen zu erhalten. Anhand der ermittelten Ergebnisse können daraus Schlüsse, z.B. über die Breite und Krümmung der Fahrbahn, gezogen werden. Die Verwendung von GPS, Digitalen Karten und Landmarken helfen die genaue Position des Fahrzeugs zu ermitteln.

Erkennung von Fahrbahn und Markierung mittels Deep Learning

Neuronale Netze, eine Methode des Machine Learning, ermöglichen eine Klassifikation mittels automatischer Merkmalsextraktion. Unter Verwendung tiefer Neuronaler Netze (Deep Learning) lassen sich bemerkenswerte Resultate z.B. in der Objekterkennung erzielen. Durch den Einsatz der speziellen Netzwerkarchitektur Full Resolution Residual Networks (FRRN) ist eine pixelgenaue Klassifikation von Bilddaten möglich. Diese Semantische Segmentierung wird verwendet um Details einer Verkehrsszene, wie zum Beispiel Fahrbahnmarkierungen und Verkehrszeichen, zu erkennen.

Zur effektiven Anwendung der FRRN-Architektur entwickeln und nutzen wir Methoden, die es uns ermöglichen eigene Trainingsdaten zu erfassen und diese mit einem eigens entwickelten Tool halbautomatisch zu labeln. Über diesen Workflow realisieren wir auch die Datenfusion mit anderen Sensordaten, wie z.B. Entfernungsinformationen.